探索高光谱成像在膀胱癌分级中的诊断价值

应用方向:

本研究展示了高光谱成像技术在肿瘤病理诊断领域,特别是膀胱癌分级预测中具有重要应用价值。该技术可获取组织切片的高维光谱信息,不仅保留显微图像的空间结构特征,还揭示不同病变程度组织在光谱反射特性上的微小差异,此外,高光谱成像具备无损、无标记和定量分析的优势,可用于病理切片中癌变区域的自动识别与特征提取,为数字病理诊断提供新的技术手段。

背景:

膀胱癌是全球*常见的泌尿系统恶性肿瘤之一,其发病率和死亡率近年来持续上升,已成为严重的公共卫生问题。肿瘤分级是膀胱癌诊疗中的关键环节,能够为个体化**方案制定和患者预后评估提供重要依据。然而,目前临床上膀胱癌的分级主要依赖病理学家对组织切片的显微观察与主观判断,这种传统方法存在诊断主观性强、依赖经验、效率低且易出错等问题,难以满足临床对快速、客观、高精度诊断的需求。

为克服这些局限,人工智能技术尤其是深度学习在医学影像分析中得到广泛应用,已在病灶检测、图像分割及肿瘤分类等任务中展现出优异表现。然而,现有研究多依赖单一模态影像,未能充分融合多模态数据的互补信息,从而限制了诊断的**性与稳定性。

高光谱成像(HSI)作为一种能够同时获取空间形态与光谱信息的新兴技术,能够揭示组织在不同波段下的光谱特征变化,对早期癌变组织具有高灵敏度和高分辨率,在皮肤癌、乳腺癌及肺癌等早期检测中已展现潜力。但其在膀胱癌分级中的应用尚处于起步阶段,尤其是结合深度学习与多模态融合的研究仍然不足。

基于此,本文提出了一种融合高光谱成像与病理图像的多模态深度学习模型,用于膀胱癌分级诊断。通过整合组织的光谱与空间结构信息,并利用深度特征融合机制,实现了对膀胱癌组织的精准分级与智能识别,为提升诊断的客观性、精度与临床可行性提供了新思路。

作者信息: 杨小青,山东**医科大学**附属医院/山东省千佛山医院病理科

期刊来源:Journal of Biophotonics

研究内容

本文提出了一种基于深度学习的多模态融合模型RVCK-net,该系统集成了HSI和病理图像以实现**的膀胱癌分级。通过利用来自两种模态的空间和光谱信息并采用自适应融合机制,实现了膀胱癌的准确分级。本研究通过将高光谱成像与深度学习的结合,实现了膀胱癌组织病理分级的快速、客观、非侵入式识别,为临床早期诊断与个体化**提供智能辅助决策依据。

实验设计

本研究的研究对象为在山东**医科大学附属**医院泌尿外科住院的非肌层浸润性膀胱癌(NMIBC)患者。病理切片采用3DHISTECH公司(匈牙利)的Pannoramic 250 扫描仪进行数字化,放大倍数为40×,共获得120张全切片图像(WSIs),其中包括50例低分级(LG)和70例高分级(HG)膀胱癌样本,用于后续数字病理分析。

实验中严格遵循标准化数据采集流程,使用20×物镜的显微高光谱系统采集高光谱数据。根据组织样本面积,每张切片采集5–8幅高光谱图像。虽然GaiaMicro-V10系统的原始空间分辨率为2048×2048像素,但研究人员手动裁剪出1392×1550像素的感兴趣区域(ROI),以聚焦于肿瘤富集区域。为保证一致性与减少采样偏差,ROI的选择由病理专家确认,仅包含肿瘤区域,排除了伪影、坏死或质量较差的图像。各病例采样数量保持一致,采用分层抽样以维持50例LG与70例HG样本在训练与测试集中的比例。所有高光谱图像数据通过光谱重采样标准化为256个光谱波段。经伪彩合成后,医生对图像进行诊断性标注:首先标定膀胱癌组织区域,再对不同分级肿瘤细胞进行分类标注。*终获得标注完备的膀胱癌组织高光谱图像块,尺寸为1392×1550×256(宽×高×波段),用于后续数字分析。

本研究中使用的采集设备是GaiaMicro-V10显微高光谱系统。GaiaMicro系列代表了能够在宽光谱范围内捕获组织光谱信息的高性能显微高光谱成像系统(400- 1000 nm)。GaiaMicro-V10配备高灵敏度CCD传感器,并具有 16 bit 的量化深度,可实现高动态范围与高精度的光谱数据采集。其光学孔径为 F/2.4,光谱分辨率为 2.8 nm,空间采样间隔(像素尺寸)为 0.5μm,可在显微尺度上获取组织的精细结构特征。系统生成的图像尺寸为 2048×2048 像素,能够实现高空间分辨率的样品精细分析并捕捉微小结构细节。其系统结构示意图如图 1 所示。

图1 显微高光谱成像系统结构示意图

研究方法

本研究选用了 Daubechies 4(db4)小波作为去噪基函数。分解层数设为 3 层,该参数通过实验确定,可在保留主要光谱特征的同时有效抑制噪声。在去噪过程中采用软阈值方法,以削弱高频噪声而不破坏关键光谱信息;阈值选取依据 Donoho 的通用阈值准则,并分别应用于每个光谱。阈值处理完成后,通过小波重构得到去噪后的高光谱图像。

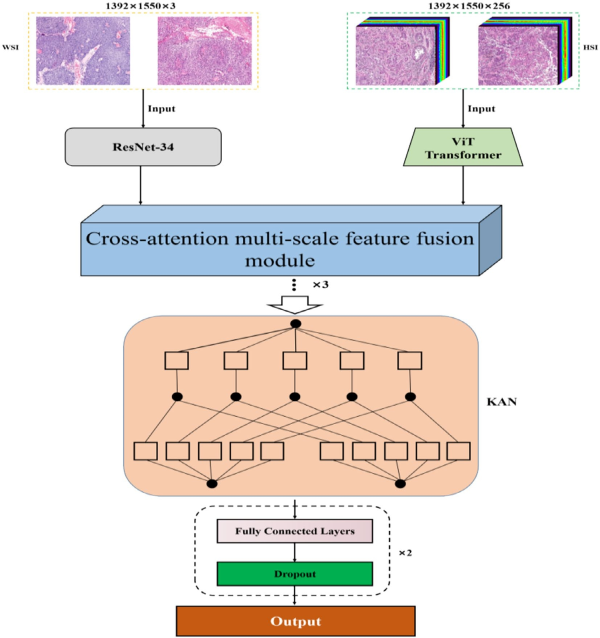

本文提出一种面向病理图像的跨模态交互融合网络——RVCK-net,其架构如图2所示。模型采用双分支设计,以 ResNet-34 与 Vision Transformer(ViT)协同完成特征提取,同步捕获局部纹理、边缘细节及全局上下文语义。ResNet-34 凭借残差连接在深层网络中有效保留局部细微特征,避免梯度消失;ViT 则通过自注意力机制建模长程依赖,提炼高阶全局语义。二者互补,为复杂病理结构的精准解析提供**表征。在此基础上,模型将两条分支提取的特征输入到基于交叉注意力机制的多尺度特征融合模块中,实现不同模态特征的高效交互与信息互补,从而增强整体特征表达能力。融合后的特征经由多层感知机(MLP)统一变换,并*终通过全连接层进行分类。

为防止模型过拟合,在全连接层前加入Dropout机制以提升模型的泛化性能。训练过程中采用 Adam 优化器(初始学习率 0.001),批大小为 32,迭代 100 轮,并使用余弦退火(cosine annealing)学习率调度器动态调整学习率。上述参数均通过验证集实验优化获得,以实现*佳收敛性与泛化效果。

图2 RVCK-net 结构图

为了客观地评估各种模型的性能,作者采用了总体准确度、**度、召回率、F1评分和Brier评分(BS)指标作为膀胱癌分类的评价标准。此外,为了证明模型在不同场景下的鲁棒性,这些评估度量与交叉验证和置信区间相结合,以提供更可靠的性能评估。

结果

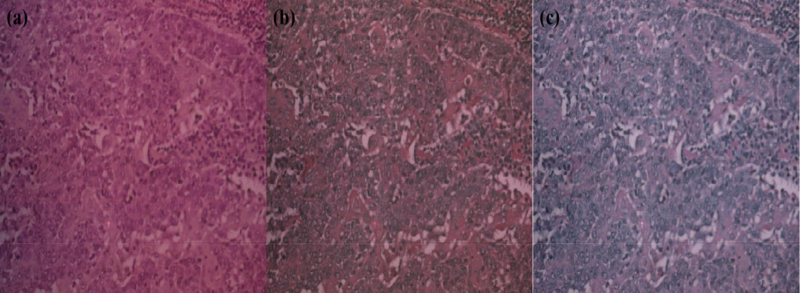

为确保高光谱成像(HSI)在膀胱癌分级中的准确性与可靠性,设计了多步预处理流程。图3 展示了从原始数据到*终去噪结果的演变,并量化各步骤对图像质量的提升效果。图3a:原始图像受噪声与照明不均影响,癌与正常组织难以区分。图3b:经反射率校正后,照明均匀性显著改善,平均信噪比(SNR)提升 21.3%,系统照明伪影被有效抑制,光谱可比性增强。图3c:进一步采用小波多尺度去噪,在保留关键光谱-空间信息的同时抑制高频噪声;峰值信噪比(PSNR)再增 3.7 dB,背景方差降低 28.6%,充分保留诊断结构并减少无关变异。

图3 高光谱图像预处理结果:(a) 原始高光谱图像;(b) 反射率校正后图像;(c) 小波变换去噪后图像。

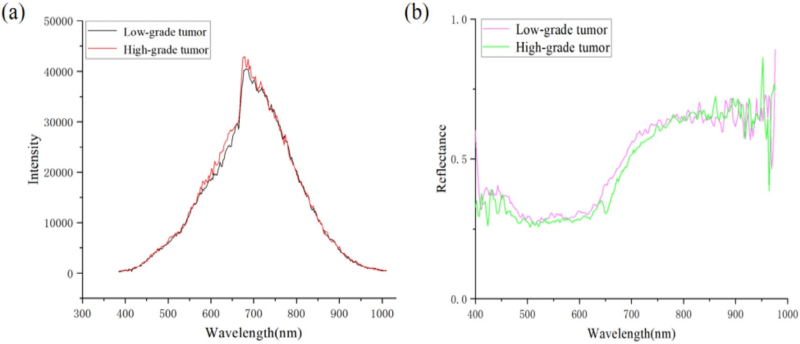

图4 展示了不同分级膀胱癌肿瘤样本经高光谱成像获取的光谱特征。(a) 为低级别与**别肿瘤的光谱强度曲线,(b) 为对应的反射率光谱曲线。两图直观呈现了不同分级肿瘤在光谱维度上的差异,为模型后续分类与分级提供了关键的光谱依据。

图4 膀胱癌光谱曲线:(a) 原始光谱曲线;(b) 校准后光谱曲线

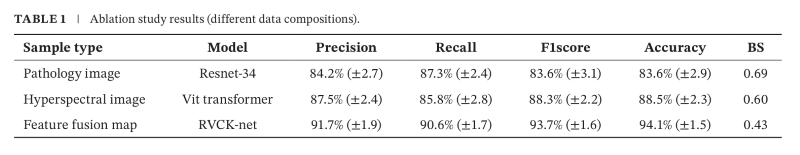

为验证多模态融合(病理 + 高光谱)在膀胱癌分级诊断中的有效性,作者设计了对照实验:先分别单独使用病理图像与高光谱图像进行特征提取与分类,以评估各模态的独立贡献;随后采用 RVCK-net 融合两类特征,验证多模态协同带来的性能增益。具体结果见表1。具体来说,病理图像模型取得了83.6%的准确率(±2.9%),Brier评分为0.69,而高光谱图像模型的精度达到88.5%(±2.3%),Brier评分降低0.60。这表明高光谱成像在捕获组织光谱细节方面的优势,使膀胱癌的诊断更加**。然而,无论是病理图像还是高光谱图像,单模态特征在准确性和鲁棒性方面都存在局限性,尤其是病理图像模型在处理数据复杂度和光谱信息方面存在局限性,而高光谱图像模型虽然能够捕捉到丰富的光谱信息,但缺乏详细的空间结构信息。

相较于单模态模型,多模态融合框架 RVCK-net 在所有指标上均实现显著提升。通过整合病理图像的空间细节与高光谱数据的光谱信息,RVCK-net 达到 91.7 % (±1.9 %) 的**率、90.6 % (±1.7 %) 的召回率、93.7 % (±1.6 %) 的 F1 分数,以及 94.1 % (±1.5 %) 的总体准确率;Brier 分数降至 0.43,表明预测概率更具置信度与可靠性。融合策略不仅大幅提高了分类精度,还在应对复杂病理特征时表现出更强的鲁棒性,充分证明多模态互补能够**捕获膀胱癌组织的空间-光谱特性,从而增强对癌变区域的识别能力(见表 2)。

为了进一步验证特征融合模块在膀胱癌分级模型中的有效性,作者使用三种不同的特征融合方法进行了消融实验:简单连接(Concat),连接后进行卷积(Concat+Conv),实验结果表明,采用简单拼接的模型准确率为88.9%(±2.3%),Brier评分为0.58。引入卷积后,准确率提高到90.2%(±2.0%),Brier得分下降到0.53,说明卷积运算起到了增强特征提取能力的作用,但随着多模态融合策略的使用,模型性能**提升,准确率达到94.1%(±1.5%),并进一步将Brier评分降至0.43,采用不同融合策略的消融实验进一步验证了多模态融合模块的优越性。

图5与图6分别展示了混淆矩阵及核心指标(准确率、**率、召回率、F1 分数)。综合可见,RVCK-net 在多项关键指标上均表现*优。图5b的混淆矩阵显示,RVCK-net仅出现1例假阳性、未发生假阴性,测试阶段所有阳性样本均被检出,这一特性对亟需高敏感度的早期筛查尤为关键。结合图6的量化指标,RVCK-net在多项评价维度上均居前列,其召回率显著优于其他模型,提示假阴性率大幅降低,同时在敏感度与**度之间实现了更佳平衡。

本研究将所提出的 RVCK-net 模型 与多种先进模型进行了对比,包括 CAFNet(基于通道注意力机制的CNN模型)、UbiSpectNet(结合Transformer结构以增强光谱特征提取的网络)、AMM-Fusion(融合空间、光谱与形态特征的注意力引导多模态融合模型)以及传统的多模态融合模型(Concat+ConvBlock)。由图6可见:CAFNet**率较高,但召回率显著落后,混淆矩阵显示假阴性多,易遗漏真实的癌变样本。UbiSpectNet同样假阴性偏高,对**别肿瘤识别能力不足。简单多模态拼接+卷积块(Concat+ConvBlock)各指标均衡,但整体性能不及RVCK-net与AMM-Fusion。AMM-Fusion凭借自适应注意力融合在各项指标上拔得头筹,表现*佳;然而其复杂架构带来的计算开销在需要高效诊断的场景下不如RVCK-net有利。

图5 各模型混淆矩阵。(a) UbiSpectNet;(b) RVCK-net;(c) CAFNet;(d) 多模态融合(Concat+ConvBlock)

图6 不同网络性能指标对比

结论

本文提出基于 RVCK-net 的多模态深度学习框架,融合高光谱与病理图像特征,实现膀胱癌的精准分级。实验结果表明,相较单模态模型,多模态融合在分类准确率、鲁棒性与诊断可靠性上均显著提升。然而,研究仍存在局限:高光谱成像设备昂贵、操作复杂、采集耗时,可能限制其即时临床应用。本方法不仅在技术层面拓展了高光谱成像的医学应用边界,也为膀胱癌早期检出与分级提供了新工具。